一、 背景介绍

2020年之后,生成扩散模型和ChatGPT的发布,彻底改变了人类对人工智能模型能力的认知。这两类模型代表了人工智能领域重大突破,并推动了 AIGC(人工智能生成内容)这个新兴领域的发展,对各行各业产生了深远的影响。其中,扩散模型(Diffusion Model)是一种通过逐渐添加噪声来学习数据分布的多模态生成模型。它可以根据文字指令编辑图像中的元素,根据文本描述生成逼真的图像、高质量音乐、语言、三维模型等。ChatGPT是OpenAI开发的大型语言模型,经过海量文本数据训练得到。它能够生成高质量的自然语言文本,并完成各种与文字相关的任务,包括知识问答、文章撰写、文章润色、文字翻译、代码生成、以及回答各类开放式且具有挑战性的问题。

进入2023年之后,GPT4的发布和扩散模型的不断发展使得文本生成、图像生成领域发展迅猛,但是在视频生成领域,扩散模型的效果依然不足,其主要原因在于:

(一)时间维度上的运动建模:视频是由一系列图像组成,且视频中存在运动中的物体以及物体与物体之间的时空交互,这使得模型需要在时间维度进行建模,并能够捕捉、理解并生成运动信息。这大大增加了模型的复杂度,且对模型生成内容的精度带来了更高的要求;

(二)高质量视频数据的匮乏:视频数据相比图像数据更加复杂,因此相比文生图模型需要更大规模且更高质量的训练数据。然而目前公开的高质量“文字-视频”数据对非常有限,无法满足训练高水平扩散模型的需求;

(三)训练难度和成本的增加:高分辨率的图像生成扩散模型的训练成本已经非常高。视频生成相比图像生成多了时间上的维度,因此视频生成的训练难度和成本也同样上升了一个维度(比如生成一个60秒的24帧率视频相当于生成1440张连续的图片)。这使得视频生成模型的训练需要大量的计算资源和时间,训练成本十分高昂。

正因为以上原因,在Sora发布之前,最先进的视频生成模型仅仅能够生成平均4秒的视频时长,而且存在视频场景单一、前背景缺乏变化、前后的一致性和稳定性难以保证等问题。因此当OpenAI公司发布文生视频大模型Sora之后,整个AIGC行业都为之兴奋和震惊。

本文将首先对Sora的能力和目前尚有的缺陷进行总结,其次根据其发布的技术文章并结合图像生成领域的背景知识对Sora背后的技术进行介绍,最后探讨Sora对各个行业的影响和对视觉大模型发展的启示。

二、 Sora的能力

简而言之,Sora具备根据用户的文字所描述的意图生成长达60秒、任何视频尺寸(如宽屏、竖屏等,见图1)、高清且基本符合真实物理逻辑和运动逻辑的高质量视频。它能够:

(一)深入理解用户的文字指令,创造出复杂的场景和运镜,生成具有高度逼真且符合用户创作意图的长达60秒的视频;

(二)基本理解并生成具备真实世界场景规律的运动中的物体以及物体与物体之间的时空交互,以及保持视频短期前后的一致性(见图2);

(三)将图像生成任务中的局部重绘(Image Inpainting),图像外扩(Image Out-painting)等技术扩展到视频生成中,能够完成视频扩展、视频补帧、根据图像生成视频等任务(见图3)。

图 1:Sora生成的不同尺寸的视频帧

图 2:Sora生成的视频中,短时被遮挡的斑点狗仍能保持前后一致

图 3:Sora根据最左边的图片生成的视频中的某两帧图示

然而,Sora依然面临一些挑战。首先模型并没有发布API接口,因此视频生成的成功率尚未可知,并且视频生成的速度以及运行时需要的计算资源和计算量也无法得知,其次,在其发布的技术文章中也描述了Sora的一些缺陷,包括:

(一)真实物理世界毕竟非常复杂,Sora的“世界模型”处于初步有效,但无法精准再现较为复杂的物理运动(见图4、5、6);

(二)Sora在生成较长视频的时候依然存在前后不一致的问题,比如物体的数量前后不一致等现象(如图7)。

图 4:Sora生成的“破损的杯子”视频的某一帧

图 5:Sora视频中的无人拿却飘在空中的椅子

图 6:Sora生成视频中,吹蜡烛时火苗却纹丝不动

图 7:Sora生成的视频中,动物的数量前后不一致

尽管Sora有上述缺陷,但其展现出了端到端的“世界模型”的可行性,视频生成能力的潜力无比巨大。随着技术的不断演进和发展,该领域有能力进一步提升视频生成能力。

三、 Sora背后的技术

Sora所使用的框架与业界经常使用的框架非常近似,它包含编解码器和扩散模型两个部分。

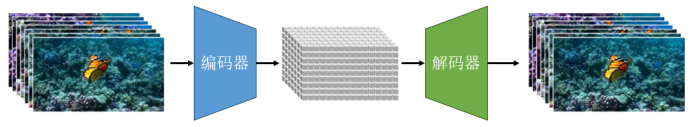

图 8:Sora中时空表示块的编解码过程:

使用编码器将原始视频转化成时空表示块,该表示块可以同解码器转化成原视频

如图8所示,编解码器中的编码器负责将原始的视频输入“压缩”成更“紧凑”的4维张量x。在OpenAI的技术报告里,x中的每个元素被称为“时空表示块”。之所以称x是对原始视频更紧凑的表示,在于表示x的单元数远小于表示原始视频的单元数。这大大减少了扩散模型需要建模的元素个数,也大大减少了计算复杂度、训练所需的计算资源和训练难度。编解码器中的解码器负责将x解码成原始视频。OpenAI并没有透露训练编解码器的框架,但是根据学术界和工业界的历史经验,该框架可能是VAE(Variational Auto-Encoder)、VQ-VAE(Vector-Quantized Variational Auto-Encoder)、或者是VQ-GAN(Vector-Quantized Generative Adversarial Network)中的一种。OpenAI也没有透露编码器和解码器的具体结构和参数量,但是根据历史经验,其结构大概率也是Vision Transformer的一个变种。

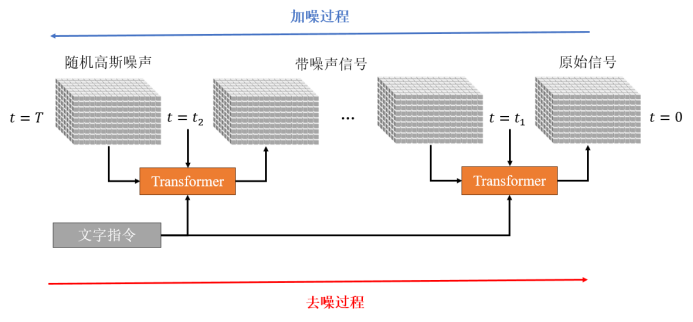

编码器把原始视频信号处理成紧凑的表示x之后,接下来Sora使用扩散模型(Diffusion Model)完成由文字到x的生成。如图9所示,Sora使用的是一个典型的扩散模型结构。扩散模型的训练过程包括前向加噪过程和反向去噪过程。其中前向加噪过程对原始信号经过T个步骤的加噪,逐渐从原始信号变成随机高斯噪声。加噪过程产生一系列从原始噪声到高斯噪声的带噪信号。扩散模型需要学习反向去噪过程,它学习一个去噪函数,逐步从高斯噪声中恢复原始信号x。

图 9:Sora中扩散Transformer模型的学习过程图示

如图9所示,Sora以文字指令为依据进行去噪过程。每一步的去噪过程以文字指令、上一时刻信号以及步骤信息为输入,预测下一时刻信号的分布,该分布为正态分布,其分布的均值和方差均由Transformer负责预测。最终,Sora以高斯噪声为起始,逐步进行T步去噪过程的采样。最终,Sora由编解码器中的解码器负责将第T步最终采样结果解码成原始视频,即完成了从文字到视频的生成过程(如图10所示)。

图 10:Sora由随机高斯噪声预测对应视频过程图示

OpenAI同样没有过多透露Transformer的具体结构。但是从Sora具备的拼接视频的能力上看,与大语言模型的自回归结构不同,Sora的扩散模型网络结构可能是一个非自回归的Transformer结构,然而具体结构细节暂时不得而知。

如上述所示,OpenAI凭借其强大的数据处理能力和超大规模神经网络训练能力使得上述技术效果远超预期。为了克服“时间维度上的运动建模”和“高质量视频数据的匮乏”问题,OpenAI在高质量数据获得方面做了巨大的投入。在OpenAI的技术报告中,其并未提到高质量视频的获取方式。在“文字——视频”对训练数据的获取方式中,其在技术报告中提到OpenAI为了训练Sora,使用了“Re-Captioning”技术,即首先训练了一个高度描述性的“视频到文字”的生成模型,然后使用它为训练集中的所有视频生成高度描述性的文字描述。使用高度描述性的“文字——视频”对训练数据训练Sora,可以显著提升视频的整体质量和视频与文字的一致性。在生成时,OpenAI还利用GPT将简短的用户提供的文字指令提示转换为更详细的文字指令,然后使用Sora完成视频的最终生成。最后,在克服“训练难度和成本的增加”上,OpenAI已经有了训练ChatGPT、GPT4等大语言模型的先进经验,因此OpenAI也有能力根据高质量训练数据训练出Sora模型。

四、 Sora对行业的影响

Sora的出现再一次验证了OpenAI践行的Scaling Law(缩放法则),即将超大规模的高质量数据用于训练一个具有超大规模的视频生成模型,最终使得Sora展现出对物理世界的超强模拟能力。

Sora对人工智能行业的影响体现在多个方面:

(一)直接影响:

1.视频生成技术路线的范例:Sora的成功为视频生成的技术路线提供了成功的范例,会加速视频生成领域甚至计算机视觉领域的技术发展和迭代。其他公司会借鉴Sora的技术方案,开发更具竞争力的视频生成产品。

2.降低视频创作难度:Sora的出现显著降低了视频创作的难度,使得普通人也能轻松创作高质量的视频内容。这将会对短视频领域的内容生成、智能创作领域带来新的变革。

3.对现有视频生成公司的挑战:Sora的成功对当前从事视频生成领域的公司,例如Runway、Pika等,带来了直接的竞争压力。Sora在技术和应用层面的领先优势,可能会抢占现有公司的市场份额。

(二)间接影响:

1.大模型潜力的再次验证:Sora的成功再次展现出大模型在各个领域的巨大潜力,对大模型技术的发展以及Scaling Law的实践提供了强有力的支持。

2.推动人工智能技术发展:Sora的突破性进展将推动人工智能领域的整体发展,并为其他人工智能技术的应用提供新的思路和方法。Sora的视频生成和时序预测能力可以与其他人工智能技术,例如大语言模型、视觉大模型等进行融合,开发出更加智能化的视频生成和应用解决方案。

3.提升人工智能研发环境:由于OpenAI在ChatGPT与Sora的接连突破,国内对大模型的研发必然会更加重视,打造更良好有序的研发环境,以促进国内研发进度。

最后Sora的成功对于电力大模型也具有以下的思考和启示:

(一)Sora的成功很大程度上归功于其使用了大量的训练数据。这表明,数据对于大模型的发展至关重要,因此大模型的研发应该继续加大对数据的收集和整理工作,并开发更有效的数据处理和管理方法。

(二)Sora学习物理世界生成和预测能力的过程和成果对电力视觉大模型具备一定借鉴意义。传统的视觉大模型往往以静态图片的理解和视频的理解为目标进行训练,期望模型能够从静态图像、视频的大规模预训练中学习得到物理世界的具备泛化性的表征。而Sora则以视频生成为目标,依靠大规模训练,同样学习物理世界的泛化性表征,最终得到具备建模物理世界和对物理世界进行时序预测的能力。因此电力视觉大模型能否借助高质量大规模视频数据进行预训练,从而提升视觉大模型对物理世界的表征能力和泛化能力,值得进一步思考和研究。

(三)Sora本身具备的视频生成和预测能力可以直接为电力视觉大模型的训练带来高质量的数据。如合成或者转换各种天气条件下的(雪天、雾天等)无人机拍摄视频数据、合成自然条件下难以捕获的视频数据等,但是具体实用性仍待调研。

(四)Sora的视频预测能力对研究电力负荷预测、设备全生命周期健康监控和预测等也具有借鉴意义,但是如何将Sora的技术用于以上业务仍需进一步挖掘。

参考链接:

[1]https://openai.com/research/video-generation-models-as-world-simulators [2]https://mp.weixin.qq.com/s/gSvxvOVqYtGcKw0ueDGbFA